Il dibattito sullo sviluppo dell’intelligenza artificiale è sempre più un tema non solo tecnologico, ma anche sociale. I risvolti di una sua più capillare diffusione sono imprevedibili. L’A.I. potrà certo avvantaggiarci, sostituendoci in varie attività che faremmo volentieri a meno di eseguire ma, essendo creata a nostra immagine e somiglianza, potrebbe anche agire non necessariamente a fin di bene.

Alla luce di queste considerazioni, c’è qualcuno che si domanda cosa succederebbe se la sua programmazione finisse in mani sbagliate. A dare una risposta ci ha pensato un gruppo di ricercatori del MIT, il Massachusetts Institute of Technology.

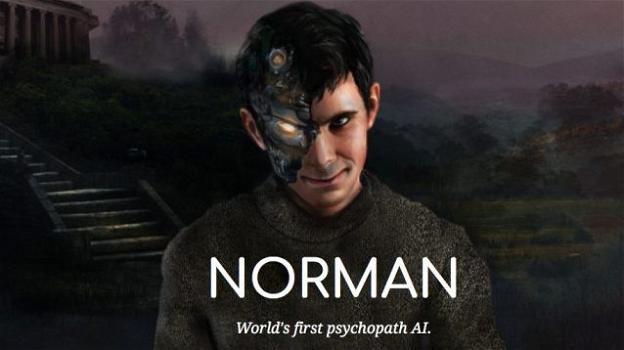

Per fornire una soluzione al quesito, il team ha dovuto creare Norman, la prima intelligenza artificiale psicopatica. Il nome non è casuale, essendo un evidente omaggio a Norman Bates, protagonista del celebre film Psycho, diretto da Alfred Hitchocock.

Dopo aver messo in piedi questo sistema di apprendimento automatico, il gruppo di ricercatori ha voluto dimostrare che, più degli algoritmi, ad influenzare le scelte del software sono i dati che gli vengono dati in pasto. Per l’occasione, i ricercatori hanno allenato Norman, mostrandogli delle didascalie legate alla morte delle persone. Come precisato sul sito del progetto, per ragioni etiche non si è potuto utilizzare immagini di persone morenti o decedute.

Sottoponendolo poi al test di Rorschach – un test sulla personalità che in passato ha avuto successo, in quanto basato sull’interpretazione di alcune macchie d’inchiostro – l’intelligenza artificiale addestrata con il tema della morte si è comportata in maniera più paranoica del “collega” a cui erano state in precedenza mostrate immagini di animali e di fiori. Così, dove l’A.I. normale interpretava le macchie come un vaso di fiori, quella paranoica ravvisava invece un uomo colpito a morte da un proiettile.

Da qui si può concludere che i dati immessi contano più degli algoritmi. Iyad Rahwan, professore associato del Mit e membro del team che ha sviluppato Norman, ha concluso che gli ingegneri dovranno per forza di cose tener conto di questo aspetto in fase di progettazione, bilanciando con cura i dati da fornire. Ma tutto ciò significa anche che il comportamento delle macchine dovrà essere studiato alla stessa stregua di quello umano.